Die Illusion der digitalen Unsterblichkeit

Digitale Daten gelten als unvergänglich – ein fataler Trugschluss, der bereits unzählige Familienarchive vernichtet hat. Während analoge Fotografien aus den 1920ern noch heute betrachtet werden können, sind digitale Aufnahmen von vor 20 Jahren oft bereits unzugänglich. Das Problem liegt nicht nur in der technischen Obsoleszenz, sondern in der begrenzten physischen Haltbarkeit der Speichermedien selbst.

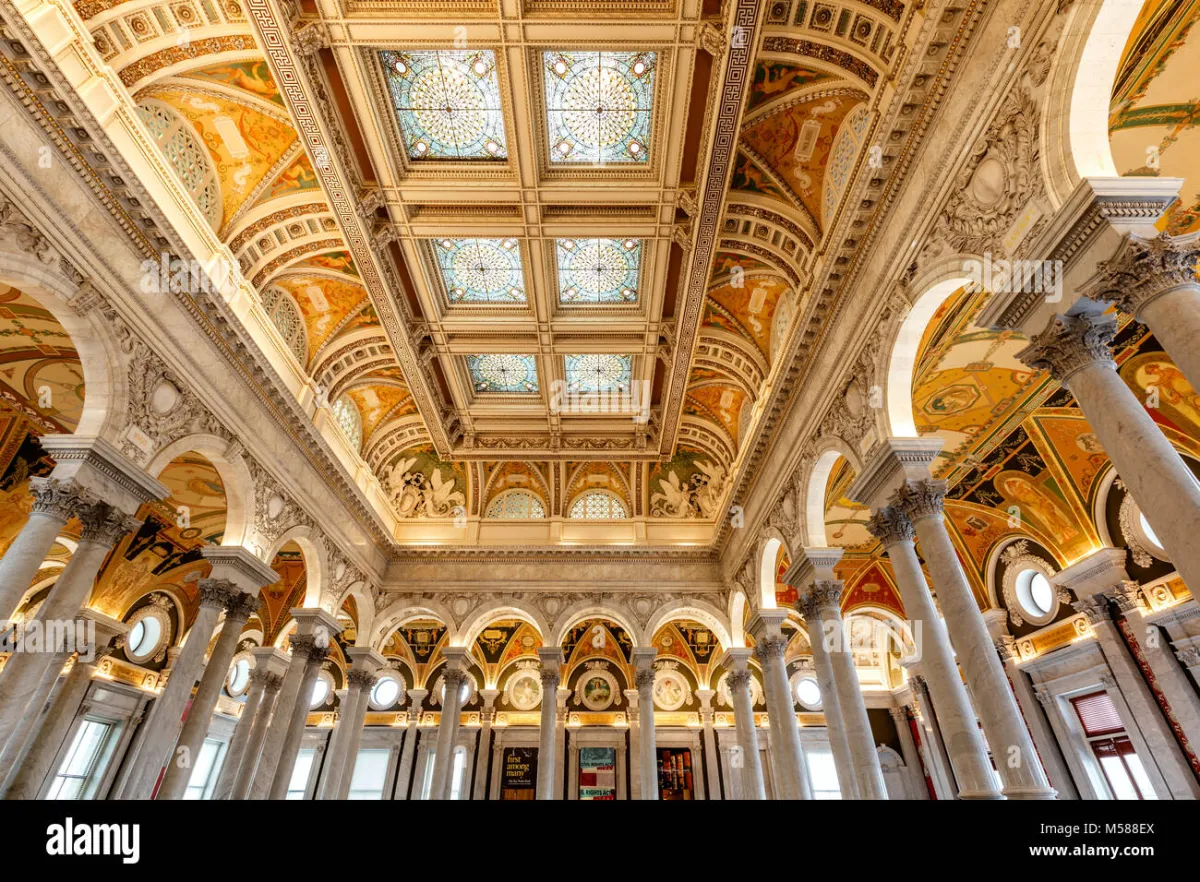

Wissenschaftliche Untersuchungen der Library of Congress und des CERN zeigen erschreckende Realitäten: Die meisten als "langlebig" beworbenen Speichermedien versagen bereits nach wenigen Jahren unter realen Bedingungen. Temperatur, Luftfeuchtigkeit und elektromagnetische Felder setzen allen Technologien zu – nur in unterschiedlichem Ausmaß.

Photo: Library of Congress, via c8.alamy.com

Photo: Library of Congress, via c8.alamy.com

Festplatten: Mechanische Zeitbomben mit Ablaufdatum

Traditionelle Festplatten (HDDs) gelten oft als robuste Langzeitspeicher, doch die Realität ist ernüchternd. Backblaze, ein Cloud-Speicher-Anbieter, veröffentlicht seit Jahren detaillierte Ausfallstatistiken seiner Festplatten-Flotte. Die Daten zeigen: Nach fünf Jahren funktionieren nur noch 85-90% aller Laufwerke zuverlässig.

Besonders kritisch sind Head-Crashes, bei denen die Schreib-/Leseköpfe die Magnetscheiben berühren und irreparable Schäden verursachen. Diese können durch kleinste Erschütterungen, Temperaturschwankungen oder einfach durch Materialermüdung auftreten.

Magnetfeld-Degradation stellt ein weiteres Problem dar: Die magnetische Orientierung der Datenbits schwächt sich über die Jahre ab. Bei ungünstigen Lagerbedingungen können Daten bereits nach 10-15 Jahren teilweise unlesbar werden, ohne dass das Laufwerk einen technischen Defekt zeigt.

Professionelle Datenrettungsunternehmen berichten von einer dramatischen Zunahme "altersbedingter" Festplattenausfälle. Laufwerke aus den frühen 2000ern sind heute oft nicht mehr lesbar, selbst wenn sie nie intensiv genutzt wurden.

SSD-Technologie: Moderne Probleme für moderne Lösungen

Solid State Drives versprechen höhere Zuverlässigkeit durch den Wegfall mechanischer Komponenten, bringen aber eigene Langzeit-Probleme mit sich. Charge Leakage – der graduelle Verlust gespeicherter Elektronen – kann bei ausgeschalteten SSDs bereits nach wenigen Jahren zu Datenverlust führen.

Enterprise-SSDs mit 3D-NAND-Technologie zeigen in Laborstudien bessere Haltbarkeitswerte, aber diese Messungen erfolgen unter idealen Bedingungen. Reale Umgebungen mit Temperaturschwankungen und elektromagnetischen Störungen reduzieren die Lebensdauer erheblich.

Write-Endurance begrenzt zusätzlich die Lebensdauer: Jede Speicherzelle kann nur eine begrenzte Anzahl von Schreibvorgängen verkraften. Consumer-SSDs erreichen oft bereits nach 3-5 Jahren ihre theoretische Grenze, auch wenn sie als "10-Jahre-Garantie" beworben werden.

Studien des IEEE zeigen, dass unbenutzte SSDs bei Raumtemperatur nach etwa 10 Jahren mit signifikantem Datenverlust rechnen müssen. Bei höheren Temperaturen verkürzt sich diese Zeitspanne dramatisch.

Optische Medien: Zwischen Mythos und Realität

DVDs und Blu-ray-Discs werden oft als Jahrhundertspeicher beworben, doch die Praxis zeigt andere Ergebnisse. Pressed Discs (gepresste kommerzielle Medien) überstehen tatsächlich Jahrzehnte, während burned Discs (selbstgebrannte Medien) oft bereits nach wenigen Jahren Probleme zeigen.

Das Problem liegt in den organischen Farbstoffen der beschreibbaren Medien. Diese reagieren auf UV-Licht, Sauerstoff und Feuchtigkeit. Selbst bei optimaler Lagerung zeigen DVD-R und CD-R nach 10-15 Jahren messbare Degradation.

M-DISC Technology verspricht Abhilfe durch anorganische Materialien. Accelerated-Aging-Tests projizieren Haltbarkeiten von über 1000 Jahren. Doch diese Hochrechnungen basieren auf Laborextrapolationen – Langzeiterfahrungen fehlen noch.

Ein praktisches Problem aller optischen Medien: Die Verfügbarkeit kompatibler Laufwerke nimmt rapide ab. Moderne Computer haben oft keine optischen Laufwerke mehr, und die Wahrscheinlichkeit, in 30 Jahren noch funktionsfähige Blu-ray-Player zu finden, sinkt kontinuierlich.

Cloud-Speicher: Verlagerung des Problems

Cloud-Dienste wie Google Drive, OneDrive oder Dropbox suggerieren permanente Verfügbarkeit, doch auch hier lauern Fallstricke. Service-Einstellungen können jederzeit erfolgen – Google hat bereits mehrere Speicherdienste beendet und dabei Nutzerdaten gefährdet.

Account-Sperrungen durch automatisierte Systeme oder Richtlinienverletzungen können jahrzehntelange Archive über Nacht unzugänglich machen. Besonders problematisch: Viele Cloud-Anbieter löschen Daten nach wenigen Monaten Inaktivität.

Die Abhängigkeit von Unternehmensstrategien macht Cloud-Speicher unkalkulierbar für Langzeitarchivierung. Was heute kostenlos angeboten wird, kann morgen kostenpflichtig oder eingestellt werden.

Zudem zeigen Studien der Carnegie Mellon University, dass Cloud-Anbieter selbst mit Hardware-Ausfällen und Datenverlust kämpfen. Die beworbenen "99,9% Verfügbarkeit" beziehen sich nur auf kurzzeitige Ausfälle, nicht auf permanente Datenverluste.

Photo: Carnegie Mellon University, via www.sightlinecommercial.com

Photo: Carnegie Mellon University, via www.sightlinecommercial.com

Wissenschaftliche Langzeit-Studien: Ernüchternde Erkenntnisse

Das CERN führt seit über 20 Jahren systematische Tests zur Datenerhaltung durch. Die Ergebnisse sind alarmierend: Ohne aktive Migration auf neue Systeme sind digitale Daten praktisch nie länger als 15-20 Jahre verfügbar.

IBM Research dokumentiert in ihrer "Digital Dark Age"-Studie das systematische Verschwinden digitaler Kulturgüter. Selbst bei professioneller Archivierung mit redundanten Systemen liegt die Verlustrate bei etwa 2-3% pro Jahr.

Die Library of Congress testet kontinuierlich verschiedene Speichertechnologien für ihre digitalen Archive. Ihr Fazit: Kein einzelnes Medium eignet sich für Jahrhundertspeicherung. Nur kontinuierliche Migration zwischen Technologien kann Daten langfristig erhalten.

Praktische Strategien für Generationen-Archive

Basierend auf wissenschaftlichen Erkenntnissen empfiehlt sich eine 3-2-1-Strategie mit Technologie-Diversifikation: Drei Kopien auf zwei verschiedenen Medientypen, eine davon extern gelagert.

Format-Wahl ist entscheidend: Offene Standards wie TIFF für Bilder oder FLAC für Audio haben bessere Langzeit-Überlebenschancen als proprietäre Formate. RAW-Formate sind problematisch, da sie herstellerspezifische Software erfordern.

Migrations-Zyklen alle 5-10 Jahre sind unvermeidlich. Planen Sie bewusst die Übertragung auf neue Medien und Systeme ein. Automatisierte Scripts können dabei helfen, große Datenmengen systematisch zu migrieren.

Redundanz durch verschiedene Technologien: Eine Kombination aus aktueller SSD für schnellen Zugriff, M-DISC für mittelfristige Archivierung und Cloud-Backup für Katastrophenschutz bietet optimalen Schutz.

Die Zukunft der Langzeitspeicherung

DNA-Speicher verspricht theoretisch Millionen-Jahre-Haltbarkeit, ist aber noch Laborforschung. Microsoft und andere Konzerne investieren massiv in diese Technologie, doch kommerzielle Verfügbarkeit liegt noch in weiter Ferne.

Quartz-Glas-Speicher wie Hitachis "Quartz Storage" soll Jahrhunderte überdauern, erfordert aber spezielle Lesegeräte, die möglicherweise nicht langfristig verfügbar bleiben.

Die realistische Erkenntnis: Perfekte Langzeitspeicherung existiert nicht. Nur aktive Datenpflege mit regelmäßiger Migration kann wichtige Informationen für nachfolgende Generationen bewahren. Investieren Sie in Systeme, nicht in einzelne Medien.